Grenoble Images Parole Signal Automatique (GIPSA-lab)

ST MARTIN D HERES CEDEX

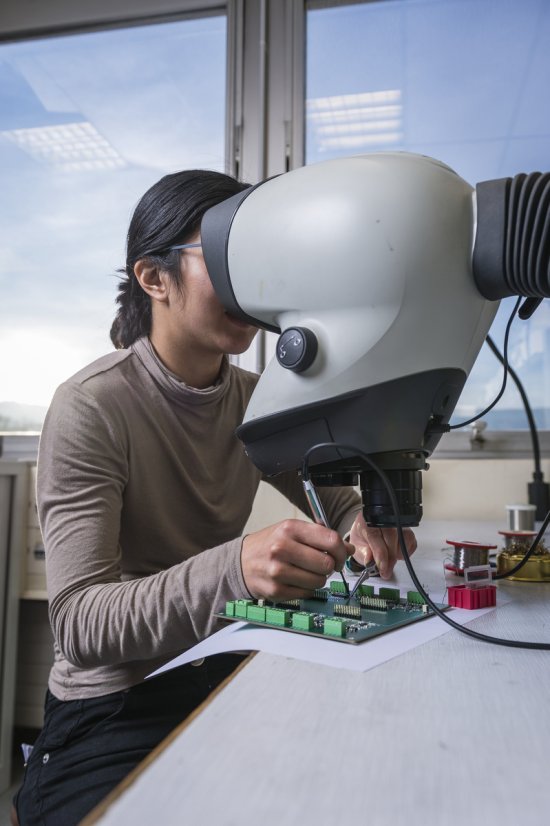

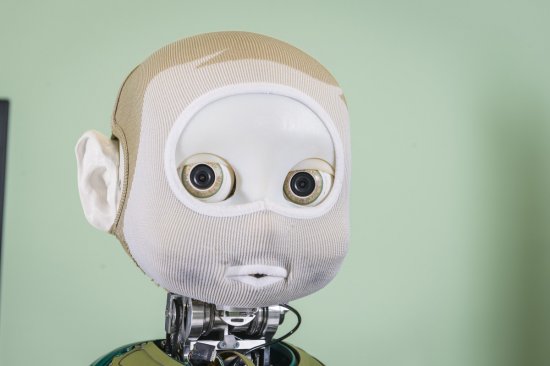

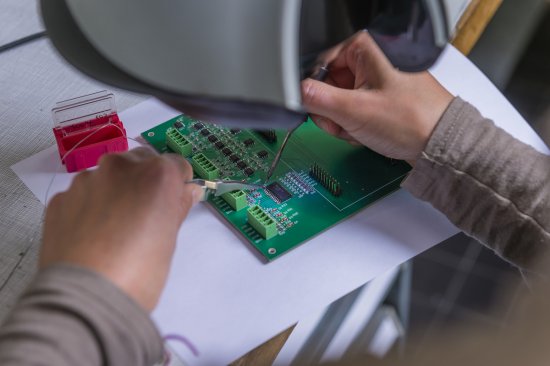

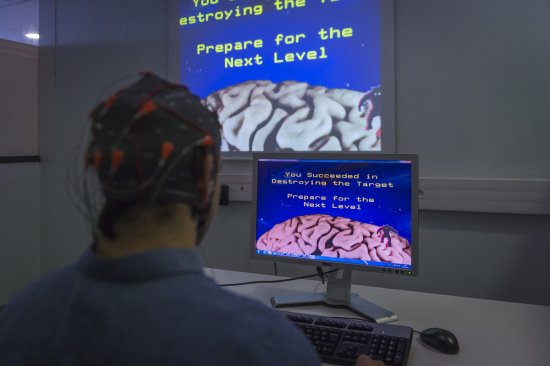

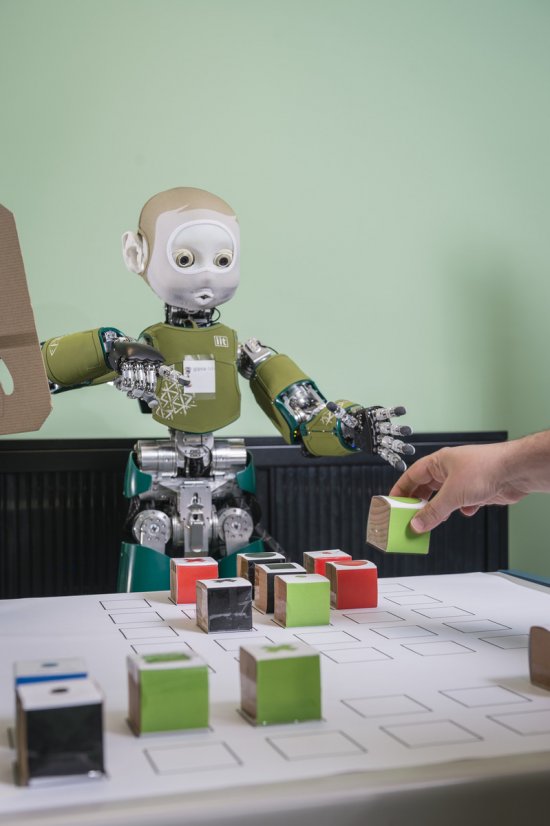

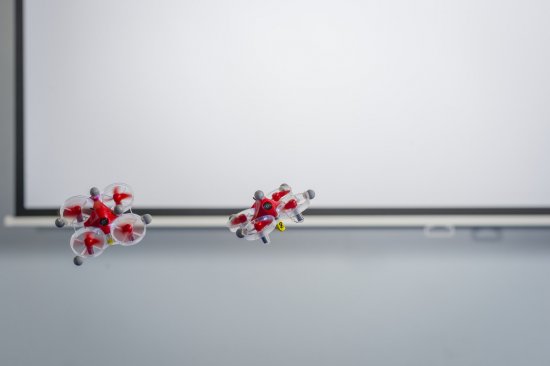

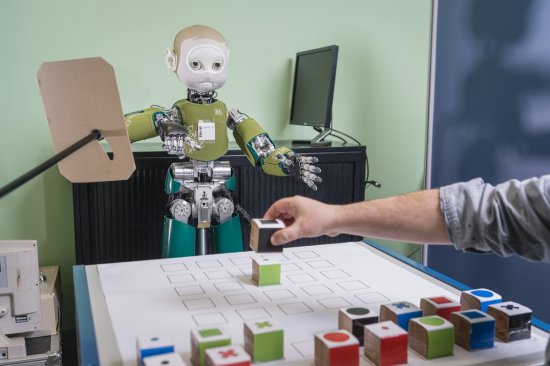

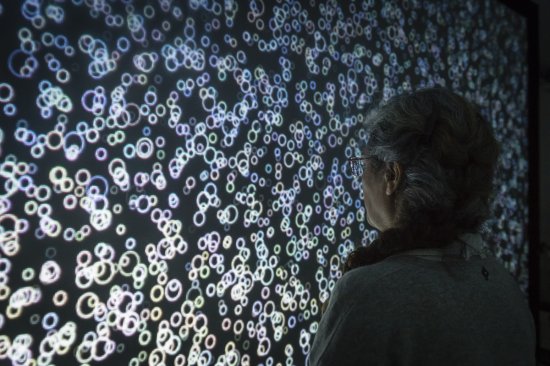

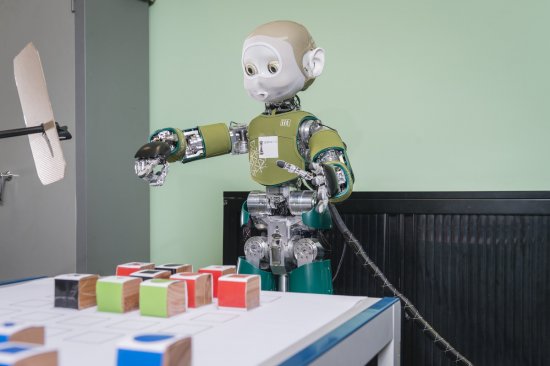

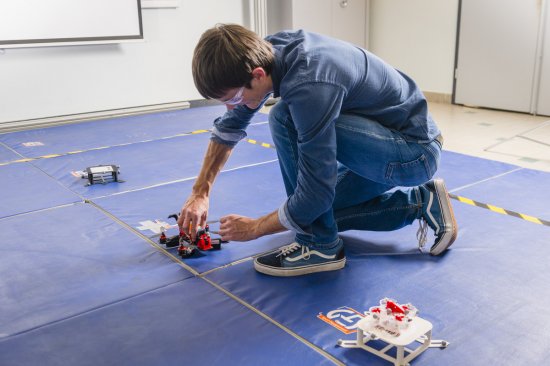

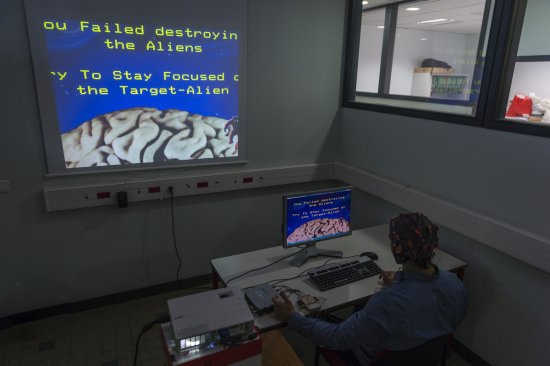

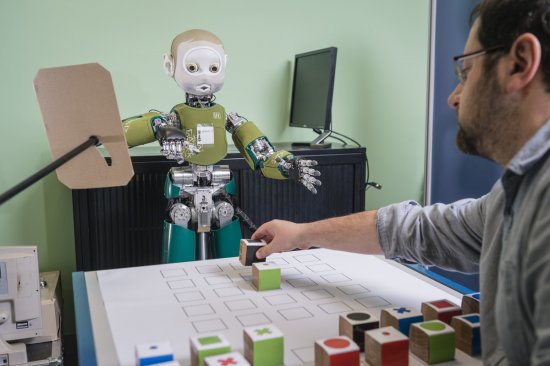

GIPSA-lab mène des recherches théoriques et appliquées sur l’automatique, le signal, les images, la parole, la cognition, la robotique et l’apprentissage. Pluridisciplinaire et à l’interface entre l’humain, les mondes physiques et numériques, ses travaux s'appuient sur des théories mathématiques et informatiques pour le développement de modèles et d'algorithmes, validés par des implémentations matérielles et logicielles.